Revue Runway AI 2026 : mon avis honnête après des tests intensifs

- Aperçu de Runway AI : faits essentiels et capacités

- Revue Runway AI : ce qu'il faut savoir avant de commencer

- Revue Runway : fonctionnalités qui comptent vraiment

- Points forts de Runway AI : ses vraies forces

- Points faibles de Runway AI : les compromis à prévoir

- À qui s'adresse Runway AI (cas d'usage idéaux)

- À qui Runway AI ne convient pas (quand éviter)

- Tarification Runway AI : forfaits, limites, et ce que vous obtenez réellement

- Comment utiliser Runway AI : un workflow simple étape par étape

- 6 fonctionnalités notables de Runway AI et leur utilité

- 1) Gen-4.5 (direction texte-à-vidéo et respect des invites)

- 2) Vidéo Gen-4 (clips contrôlables rapides de 5 à 10 secondes)

- 3) Images-clés (pour transitions intentionnelles)

- 4) Contrôle caméra style réalisateur

- 5) Act One / Act Two (là où la performance du personnage mène la scène)

- 6) Lip Sync + nettoyage pratique (Retouche / Suppression arrière-plan)

- Alternatives à Runway AI : outils similaires à comparer

- FAQ Runway AI : réponses rapides pour nouveaux utilisateurs

- Conclusion : Runway en vaut-il la peine ?

Si vous voulez la version courte, cette revue de Runway AI se résume à une chose : Runway est à son meilleur lorsque vous le considérez comme une "machine à plans" contrôlable (plus une boîte à outils IA pratique), et non un studio de cinéma en un clic. Ses derniers modèles vidéo mettent l'accent sur la qualité du mouvement et le respect des invites, et la plus grande valeur de la plateforme est la combinaison de génération + contrôle + utilitaires d'édition pratiques en un seul flux de travail.

Je rédige ceci à la première personne car la plupart des "revues Runway" ressemblent à des listes de fonctionnalités — et ce n'est pas ainsi que les créateurs décident. Je vais expliquer ce que je dirais à un collègue avant que nous dépensions des crédits, ce que je testerais en premier, ce qui m'a surpris, et où Runway vous oblige encore à faire des compromis.

Aperçu de Runway AI : faits essentiels et capacités

Runway est une suite créative basée sur des crédits, accessible en priorité sur navigateur, où le "coût réel" est mesuré en secondes générées et en itérations — et non seulement par le tarif mensuel.

Runway est une suite créative basée sur des crédits, accessible en priorité sur navigateur, où le "coût réel" est mesuré en secondes générées et en itérations — et non seulement par le tarif mensuel.

Voici le résumé que j'aurais aimé qu'on me donne avant que je clique sur "s'abonner" :

| Catégorie | Ce que je retiendrais | Pourquoi c'est important |

|---|---|---|

| Focus principal | Vidéo générative + mouvement contrôlable + workflows créatifs | Ce n'est pas juste du texte-à-vidéo ; les contrôles et workflows sont essentiels |

| Modèle tarifaire | Forfaits mensuels avec crédits mensuels (gratuit donne des crédits uniques) | Vous budgetez en crédits, pas en impressions |

| Plus gros "wow" | Nouveaux modèles améliorant qualité du mouvement + respect des invites | Moins de dérive, meilleure continuité (pas encore parfaite) |

| Meilleur usage | Plans courts, contenus publicitaires, tests de scènes, séquences stylisées | Vous assemblez ensuite les résultats ailleurs |

| Frictions courantes | Coût des itérations, courbe d'apprentissage des contrôles, bizarreries occasionnelles | Les meilleurs résultats viennent d'un guidage intentionnel |

Revue Runway AI : ce qu'il faut savoir avant de commencer

Si vous attendez que Runway réussisse une scène complexe en une seule génération, vous brûlerez vite vos crédits — mais si vous l'abordez comme une chaîne de production plan par plan, il devient extrêmement productif.

Le modèle mental qui m'a le plus aidé : Runway est un système pour produire "des plans utilisables" en volume, pas un système qui garantit "le film final". La plateforme ajoute continuellement plus de contrôles (images-clés, termes de caméra, stylisation vidéo-à-vidéo, outils de performance comme Act-One/Act-Two, etc.), ce qui la rend plus prévisible — mais aussi moins "un bouton".

Un dernier réajustement d'attentes : le positionnement du plus récent modèle est très clair sur ce qu'il cherche à optimiser — qualité du mouvement, respect des invites, cohérence temporelle et contrôlabilité. C'est précisément ce qui importe pour les créateurs souhaitant réaliser des clips crédibles plutôt que de la "purée IA".

Revue Runway : fonctionnalités qui comptent vraiment

Les fonctionnalités qui influencent vraiment vos résultats sont les couches de contrôle (caméra, images-clés, pilotage de la performance) et les "outils de correction" (étendre, supprimer l'arrière-plan, retouche), pas la simple boîte d'invite.

Quand j'évalue Runway, je ne commence pas par "texte-à-vidéo". Je commence par : Puis-je diriger le plan ? Puis-je itérer efficacement ? Puis-je corriger les erreurs sans tout recommencer ?

Les fonctionnalités qui font constamment la différence pour moi :

- Choix du modèle selon la tâche : turbo plus rapide pour explorer vs haute fidélité pour plans héros

- Images-clés & contrôle caméra : pour transitions, rythme et mouvement intentionnel

- Stylisation vidéo-à-vidéo : si vous avez déjà des séquences et recherchez un look cohérent

- Étendre la vidéo : pour changer le format sans "rééditer toute votre vie"

- Outils de performance (Act-One/Act-Two) + lip sync : quand la performance des personnages compte plus que le mouvement pur

- Outils utilitaires (Supprimer l'arrière-plan / Retouche) : quand vous avez juste besoin d'un travail de production rapide

Points forts de Runway AI : ses vraies forces

Runway brille lorsque vous voulez un mouvement à l'allure cinématographique avec un vrai contrôle créatif, surtout pour du contenu court et l'idéation de plans.

1) Le contrôle est une fonctionnalité de premier ordre (pas une option)

Beaucoup d'outils génèrent du mouvement ; peu vous offrent un ensemble croissant de moyens pour le diriger. Runway a clairement associé contrôles du mouvement (termes caméra et workflows type images-clés) aux améliorations des modèles.

2) Forte "cohérence de workflow"

Runway ne se limite pas à la génération ; il s'agit aussi de passer de l'idée → plans brouillons → actifs utilisables sans jongler avec trop d'onglets. Même les basiques comme les flux d'export ou l'organisation des actifs comptent lorsque vous faites beaucoup d'itérations.

3) Éditions quotidiennes, plus rapides

Étendre la vidéo et supprimer l'arrière-plan sont des fonctionnalités qui ne paraissent pas séduisantes en démo, mais font la différence entre "je peux livrer ça" et "je suis bloqué".

4) L'orientation modèle répond aux plaintes des créateurs

Le positionnement de Gen-4.5 met l'accent sur réalisme du mouvement, cohérence temporelle et respect des invites — les points douloureux qui font que la vidéo IA semble artificielle.

Points faibles de Runway AI : les compromis à prévoir

Les compromis sont prévisibles : le coût peut grimper via les itérations, les contrôles avancés demandent de la pratique, et des glitches visuels marginaux subsistent.

Si un ami me demandait, je lui dirais :

- Les crédits pénalisent les "relances d'invites". Si vous itérez sans plan, vous le paierez — littéralement. Les crédits alimentent génération image, vidéo et audio.

- Les meilleurs résultats demandent "l'esprit de réalisateur". Dès que vous utilisez termes caméra, images-clés et outils de performance, la sortie s'améliore — mais vous passez aussi du temps à apprendre le système.

- Tous les outils ne sont pas "niveau éditeur moderne". Des concepts hérités existent encore, mais Runway s'est clairement orienté vers des workflows génératifs plutôt que maintenir un éditeur traditionnel complet.

- Les limites du modèle persistent. Même avec de grands progrès, permanence des objets et cohérence causale peuvent vaciller dans des scènes complexes (un problème global, pas seulement Runway).

À qui s'adresse Runway AI (cas d'usage idéaux)

Vous devriez utiliser Runway si vous produisez des vidéos courtes, publicités, ou expériences créatives où "itérations rapides de plans" l'emportent sur "prises longues parfaites".

Je recommanderais Runway aux équipes :

- Contenu social créant visuels percutants, transitions, et clips stylisés

- Réalisateurs indépendants / créateurs de clips musicaux construisant des séquences à partir de plans courts

- Designers voulant prototypes de mouvement et expériences de style de marque

- Équipes marketing produisant variantes créatives à grande échelle (surtout quand plusieurs looks sont nécessaires rapidement)

Si vous voulez spécifiquement explorer un pipeline plus simple axé sur la conversion d'images fixes en mouvement pour marketing ou narration, vous vous intéresserez probablement aussi aux workflows image vers vidéo — Runway y joue un rôle fort quand votre première image est bonne.

À qui Runway AI ne convient pas (quand éviter)

Si vous avez besoin de longues scènes cohérentes avec personnages sans aucune dérive (ou que vous détestez itérer), Runway peut sembler cher et frustrant.

Je déconseillerais (ou retarderai l'achat de) Runway si :

- Vous avez besoin de scènes longues, avec dialogues lourds où performance et continuité doivent être verrouillées pour des minutes

- Votre workflow nécessite une édition précise au cadre près dans un seul outil (vous préférerez peut-être un NLE dédié)

- Vous n'avez pas le temps d'apprendre structure d'invites, termes caméra, et contrôles

- Vous êtes allergique aux calculs de crédits

Tarification Runway AI : forfaits, limites, et ce que vous obtenez réellement

Les forfaits Runway sont simples sur le papier, mais la vraie question est combien de "secondes utilisables" vous pouvez vous permettre par mois pour votre workflow.

Runway publie ses niveaux de forfaits et conversions "crédits → secondes" directement sur sa page de tarification, ce que j'apprécie car cela aide à planifier réalistement.

Voici le résumé clair (chiffres annuels montrés sur la page référencée) :

| Forfait | Prix (annuel) | Crédits | À quoi il sert selon moi |

|---|---|---|---|

| Gratuit | 0 $ | 125 crédits uniques | Test rapide seulement (vous serez vite à court) |

| Standard | 12 $/utilisateur/mois | 625/mois | Créateurs réguliers pour plans courts |

| Pro | 28 $/utilisateur/mois | 2250/mois | Itérations lourdes, équipes, besoins de production importants |

Quelques réalités crédit à garder en tête :

- Les crédits couvrent tous types de médias (image, vidéo, audio), votre mix d'usage compte.

- Les conversions varient selon le modèle (Gen-4.5 vs Gen-4 vs variantes Turbo), ne supposez pas que "secondes = secondes".

- Si votre processus est "générer 30 fois pour obtenir une bonne prise", votre budget explosera.

Si vous voulez la référence officielle de tarification, voici un lien autoritaire :

Page de tarification Runway (officielle)

Comment utiliser Runway AI : un workflow simple étape par étape

La façon la plus simple d'obtenir de bons résultats est de verrouiller votre première image, d'écrire les invites comme une liste de plans, puis d'ajouter des contrôles seulement après que le mouvement de base vous plaise.

Voici le workflow que je recommande aux débutants (et que j'utilise encore dans une version moi-même) :

- Commencez par une première image forte

Utilisez une image claire avec sujets lisibles et bonne lumière. Gen-4 supporte workflows image-à-vidéo et guide par invite met l'accent sur image + texte pour le contrôle. - Décrivez le plan directement — évitez la poésie Traitez cela comme : sujet + action + caméra + environnement + style + contraintes.

- Générez d'abord des clips courts (5 à 10 s)

Surtout en testant comportement de mouvement et choix caméra. - Ajoutez images-clés ou contrôle caméra une fois le fond prometteur

Les images-clés lissent les transitions ; le contrôle caméra fixe la direction/l'intensité du mouvement. - Utilisez Étendre la vidéo / Vidéo-à-vidéo pour finition et réutilisation

Étendre la vidéo pour changements de format ; vidéo-à-vidéo pour style cohérent entre clips. - Corrigez les problèmes pratiques avec les outils utilitaires

Supprimer l'arrière-plan et Retouche sauvent de devoir tout refaire. - Exporte et finalisez dans votre éditeur principal

Pour beaucoup de séquençage, je préfère toujours un NLE dédié pour l'assemblage final.

6 fonctionnalités notables de Runway AI et leur utilité

Ces six fonctionnalités vous donnent le signal le plus rapide pour savoir si Runway correspond à votre workflow — car elles couvrent génération, contrôle, performance des personnages et nettoyage de production.

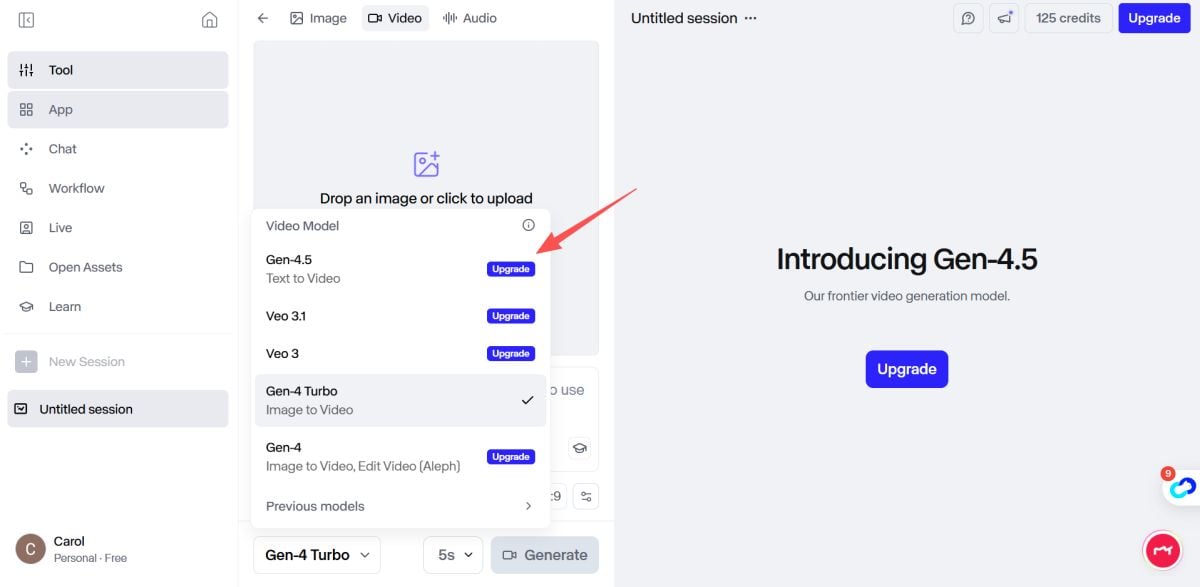

1) Gen-4.5 (direction texte-à-vidéo et respect des invites)

Si votre priorité est "ça suit les instructions et garde le mouvement cohérent", c'est la direction modèle à tester en premier. Runway présente Gen-4.5 comme le nec plus ultra en qualité du mouvement et respect des invites, et fait aussi référence à un positionnement benchmark.

Si votre priorité est "ça suit les instructions et garde le mouvement cohérent", c'est la direction modèle à tester en premier. Runway présente Gen-4.5 comme le nec plus ultra en qualité du mouvement et respect des invites, et fait aussi référence à un positionnement benchmark.

Référence interne : Runway Gen 4.5

Contexte officiel :

Annonce de recherche Runway Gen-4.5

2) Vidéo Gen-4 (clips contrôlables rapides de 5 à 10 secondes)

C'est le test "pain et beurre" : pouvez-vous générer des clips courts et contrôlables qui semblent utilisables ? La documentation Runway Gen-4 décrit des durées de 5 ou 10 secondes à partir d'une image d'entrée + invite texte.

3) Images-clés (pour transitions intentionnelles)

Les images-clés sont l'un des moyens les plus rapides de réduire le hasard — surtout si vous essayez de passer d'un état visuel à un autre. Le guide images-clés Gen-3 de Runway les positionne explicitement pour des transitions fluides.

4) Contrôle caméra style réalisateur

Si vous tenez au mouvement cinématographique, testez tôt le contrôle caméra. Runway propose un workflow dédié pour Gen-3 Alpha Turbo, conçu pour spécifier la direction et l'intensité du mouvement.

Vue d'ensemble officielle :

No Film School sur le mode réalisateur Runway (vue d'ensemble)

5) Act One / Act Two (là où la performance du personnage mène la scène)

C'est là que Runway commence à ressembler à un "outil de performance", pas seulement un générateur. Runway a lancé Act-One pour créer des performances expressives de personnages via des vidéos entrants dans Gen-3 Alpha, et la même page note la disponibilité d'Act-Two pour les forfaits payants.

6) Lip Sync + nettoyage pratique (Retouche / Suppression arrière-plan)

Pour le contenu tête parlante, Lip Sync est simple : il synchronise texte-à-voix ou audio importé, supporte plusieurs visages, et a des contraintes claires (type de visage et limites de dialogue).

Pour le nettoyage de production, Retouche supprime les objets indésirables sur un clip, et Suppression arrière-plan offre un workflow style fond vert dans les outils Runway.

Alternatives à Runway AI : outils similaires à comparer

Si Runway est trop cher ou trop "basé plans", vous voudrez probablement des alternatives optimisant pour des scènes plus longues, des templates plus simples ou des itérations moins coûteuses.

J'aime comparer les alternatives selon le problème qu'elles résolvent mieux :

- Cohérence narrative plus longue / forces différentes des modèles

- Pipelines vidéo marketing basés sur modèles

- Hubs tout-en-un pour créateurs qui priorisent d'autres workflows

Si vous comparez des plateformes pour votre propre public, vous pourriez positionner Runway AI comme le choix "contrôle cinématographique", puis comparer avec un hub créateur plus simple comme GoEnhance AI.

FAQ Runway AI : réponses rapides pour nouveaux utilisateurs

La plupart des questions débutants dans les revues Runway AI se réduisent à trois choses : quel modèle choisir, comment fonctionnent les crédits, et comment obtenir plus de contrôle sans complexifier les invites.

Runway est-il gratuit ?

Oui, il y a un forfait Gratuit, mais c'est mieux considéré comme une démo car il inclut 125 crédits uniques (pas mensuels).

Comment fonctionnent les crédits en pratique ?

Les crédits sont utilisés pour générer images, vidéos et audio — donc votre charge créative totale partage un seul budget.

Quel est le moyen le plus rapide d'améliorer les résultats ?

Utilisez une première image forte, gardez les invites structurées comme une liste de plans, puis ajoutez images-clés/contrôle caméra seulement après que la génération de base vous convienne.

Runway prend-il en charge le lip sync et le dialogue des personnages ?

Oui — le lip sync synchronise texte-à-parole ou audio importé, peut gérer plusieurs visages (jusqu'à quatre), et a des contraintes claires sur type de visage et cadrage.

Quel est le consensus commun des "revues Runway" ?

Dans ma lecture des revues Runway AI, le thème commun est : excellent contrôle créatif pour plans courts, mais vous devez gérer coût des itérations et attentes.

Conclusion : Runway en vaut-il la peine ?

*Runway vaut la peine si votre travail bénéficie de plans courts contrôlables à l'allure cinématographique — et ne vaut pas la peine si vous avez besoin de longues scènes, de résultats prévisibles en une passe, ou que vous détestez l'itération basée sur crédits.

Si je devais résumer ma règle d'achat : Runway se rentabilise quand il remplace des heures d'expériences sur le mouvement, de tâches de nettoyage, et de storyboard "et si" par des itérations rapides que vous pouvez vraiment utiliser. Mais il faut l'aborder avec intention : planifiez vos plans, testez les contrôles tôt, et surveillez les crédits.